こんにちは、散花月です。

さて最近AI関連の話題が活発になってきているので私も自身のPCへGoogleのgemma4を導入してみました。

その手順を覚書として残しておこうと思ったのが今回の内容となります。

環境は限定されてしまいますがもし皆様がゲーム以外でAIを自分のPCで動かしたい!という場合にご参考になれば幸いです。

※以降の手順はあくまで一例であり、実施を誤るとPCが動作しなくなるという可能性は無きにしも非ずなので自己責任でよろしくお願いいたします。

目次

使用環境

まずは使用する環境のご紹介です。

・マザーボード:B550M Steel Legend

・OS:Windows11 Pro

・CPU:AMD Ryzen9 5900x

・GPU:RTX 5070ti

・メモリ:64GB(16GBx4)

・SSD:1GB Gen4

構成自体は少し前のAM4で組まれていてマザーボードもMなので小型サイズとなります。

ケースもNZXTのH3 Flowに入れていてケースファンフル稼働で稼働中です。

オールnoctua製の回転数固定としているので負荷をかけても結構静かに動作します。

もっとも、5070tiだけ高負荷時に鳴るファン音が少しだけ気になってはいますが(^_^;)

また、CPUの設定で仮想化が有効となっていないとDockerが使えないのでご注意下さい。

(以降の画像はクリックすると拡大します)

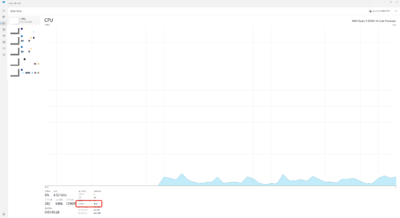

↑はメインPCのCPU(5950x)で、赤枠が該当箇所となります。

もしここが無効となっている場合はBIOS等の設定変更が必要となりますがここでは省略します。

(インターネット上に情報は載っているので気になる方は調べてみて下さい)

WSL2のインストール

次にWSL2のインストール実施です。

以下のコマンドをPowerShell(管理者権限)から実行を行い、エンターを押してWSLのインストールを行います。

|

1 |

wsl --install |

次にWSLのバージョンを2へ切り替えを行い、

|

1 |

wsl --set-default-version 2 |

PCを再起動して次の手順へ。

ubuntuのインストール

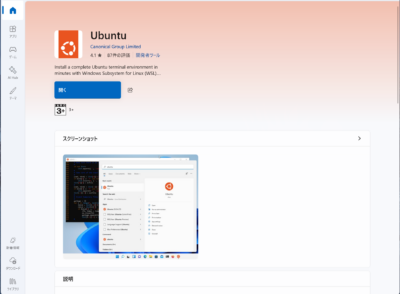

WSL2が導入出来たら今度はubuntuインストールの実施です。

Microsoftのストアからubuntuを探して、

インストールを行います。

完了してアプリケーションを実行するとユーザー名とパスワードを聞いてくるので自身の好きなIDとパスワードを入力して下さい。

ただパスワードを忘れてしまうと再インストール作業など色々と面倒なので何処かへ控えておくのをおすすめします。

Dockerデスクトップのインストール

次にDockerデスクトップのインストールを実施します。

公式サイトからダウンロードしてインストーラーを起動。

チェックは変更せずそのまま次へ進めていけば完了します。

https://docs.docker.com/get-started/get-docker/

起動した後は利用規約が表示されるので「Accept」をクリックしてDockerデスクトップが起動すればOK。

また設定のResourcesにあるWSL intergrationでUbuntuをONにします。

↑ここがONになっているとubuntuの環境と同期が可能です。

nvidia-container-toolkitのインストール

dockerが起動したら次にnvidia-container-toolkitをインストールします。

以下のコマンドをubuntu上から実施すると導入まで完了出来ました。

|

1 |

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg && curl -s -L https://nvidia.github.io/libnvidia-container/stable/deb/nvidia-container-toolkit.list | sed 's#deb https://#deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://#g' | sudo tee /etc/apt/sources.list.d/nvidia-container-toolkit.list |

(パスワードを聞かれた場合は自身で設定した値を入力)

ここまで完了した時点でPCまたはDockerデスクトップの再起動をしておくと良いかもしれません。

ご参考となりますが私は一旦Dockerデスクトップの再起動を行いました。

Dockerへcudaイメージのインストール

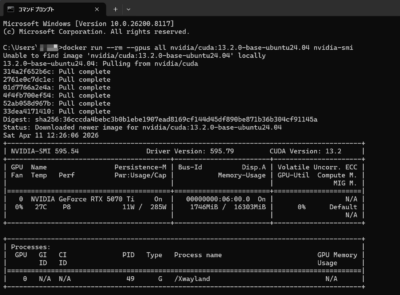

ツールキットのインストールまで完了したらdocker経由でcudaイメージのインストールまで行います。

まずdockerデスクトップを起動した状態でdocker hubにて使用したいバージョンの確認を実施。

https://hub.docker.com/r/nvidia/cuda/tags?name=13.2.0-base-ubuntu24.04

私の場合は自PCへインストールしたubuntuが24.04だったので、上記のリンク先のコマンドをコマンドプロンプトから実施しました。

|

1 |

docker run --rm --gpus all nvidia/cuda:13.2.0-base-ubuntu24.04 nvidia-smi |

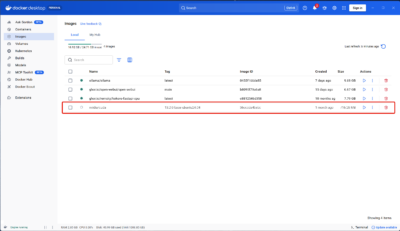

完了後にDockerのイメージ項目へcudaが作成されたら次の手順へ進みます。

Dockerへollama経由でAIコンテナのインストール

これでようやくDockerの仮想環境が整ったので自分のPCへAIのインストルールしていくのですが、

今回はollamaを利用してgemma4を入れてみようと思います。

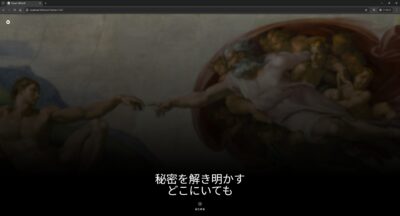

https://ollama.com/

↑何気に画像がかわいいです(笑)

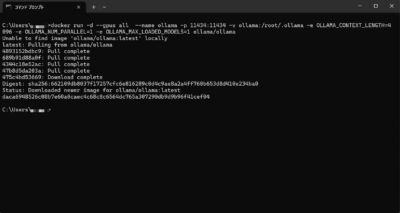

まずPC上へollamaをインストールするためにコマンドプロンプトから以下のコマンドを実行します。

|

1 |

docker run -d --gpus all --name ollama -p 11434:11434 -v ollama:/root/.ollama -e OLLAMA_CONTEXT_LENGTH=4096 -e OLLAMA_NUM_PARALLEL=1 -e OLLAMA_MAX_LOADED_MODELS=1 ollama/ollama |

コマンドのパラメータはある程度柔軟に変更出来るのでCONTEXT_LENGTHを変更したい、等がある場合はいじってみて下さい。

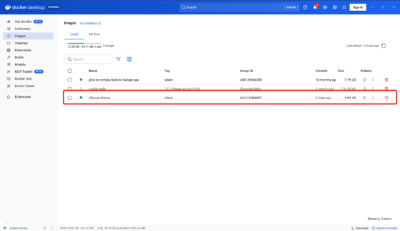

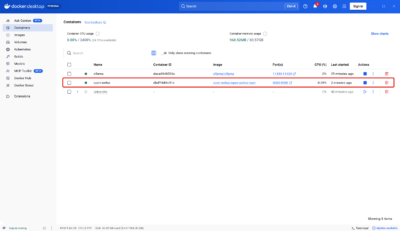

完了すると下の画像の通りDockerデスクトップのイメージへollamaが作成されており

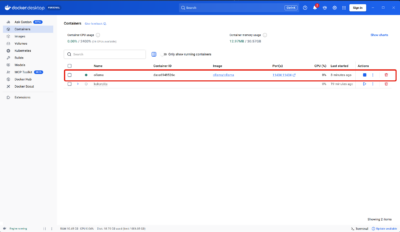

同時にコンテナにもollamaが作られています。

↑右にある再生マークが「□」になっていれば動作中となります。もし▷となってしまう場合は起動が失敗しているので手順や設定事項などを確認が必要です。

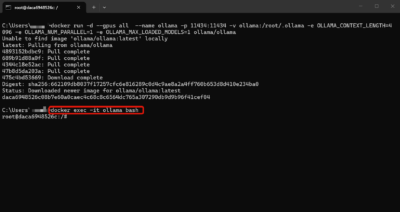

この状態からコンテナへ入れるのでコマンドプロンプトから以下のコマンドを実施してコンテナへ入ります。

|

1 |

docker exec -it ollama bash |

あとはollamaのサイトからgemma4のモデルを指定してダウンロードすれば完了です。

例えばgemma4のlatestを導入したい場合は以下のURLからを確認を行い

https://ollama.com/library/gemma4

載っているコマンドを実行します。

|

1 |

ollama run gemma4 |

↑gemma4の後ろに:を付ける事でモデル名の指定も可能です(何も付けないとlatestモデル)。例えばe2bを指定する場合はgemma4:e2bとなります。

するとダウンロードとインストールが完了して質問を入力する表示となるので

「こんにちは!」と入れるときちんと日本語で返答してくれました!

終了したい場合は/byeと入れてエンターキーを押せばgemmaを終了します。

最後にexitを入れて同様にキーを押すとコンテナからも抜ける事が出来ました。

この状態にしたらコマンドプロンプトも閉じてしまっても問題ありません。

あとollamaコマンドについてはollama listで現在導入したAIのインストール状況を確認出来ます。

![]()

この中から削除したい場合はollama rm (削除したいAI)コマンドを利用します。

例えば今回のgemmaであればollama rm gemma4:latestと入れると画像の通り削除を完了した旨のメッセージが表示されコンテナからAIを除去出来ます。

![]()

DockerへWebUIコンテナのインストール

とりあえずここまで実施してgemmaをコンテナへインストールすることが出来たのですが、

コマンドではなくChatGPTやgeminiのように画面側から操作をしたいと考える方もいらっしゃると思います。

その場合はWebUIをインストールすれば可能なので早速コマンドプロンプト」から以下のコマンドを実施。

|

1 |

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main |

すると画像の通りイメージとコンテナの作成をしたという表示まで確認出来たので

Dockerデスクトップ上を確認するとコンテナの作成が完了しています。

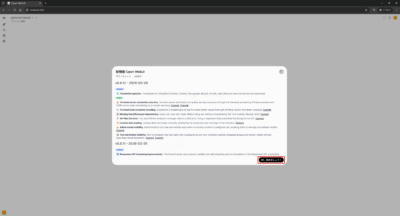

しかしすぐには使えないので10分程度待機をしてから以下のURLをchromeなどのブラウザで実行を行うと

http://localhost:3000/

WebUIの画面が表示されました!

あとは下の矢印をクリックして

メールアドレスとパスワードを入力、管理者アカウントを作成ボタンを押せば

ChatGPT等と同じような画面が表示されました。その後「OK!始めましょう」を押して

試しに「こんにちは!」と入れて投稿ボタンを押すと

gemmaが反応します。あとは今までのAIと同じ使い方でOKです。

(オプションも色々ありますが一旦今回は動作するところまでのご紹介なので省略します)

最後に

以上、必要最低限の手順で自分のPCへAIを導入出来る手順をご紹介してみましたがいかがでしたでしょうか?

今回載せた内容は色々なサイトやAIに聞いて構築したので不要な手順があるかもしれません。

その場合は抜かして実施を行ってもらえると幸いです。

加えてコマンドにおけるダウンロードとインストールや画面表示もPC自体の性能に依存します。

よって動作しない場合は少し時間を置いてみたりPCの再起動をされてみて下さい。

私もAIへ聞きながら導入出来たので上手くいかない場合はインターネット上の情報あるいはChatGPT等で調べるのがおすすめです。

それでは失礼致しますm(_ _)m

よってRadeonのRXシリーズだと上述した手順では動作出来ない可能性が高いのでご了承下さいませ。

ただ最近はレモネードというAmdCPUやRadeon側のGPU優先で動作するアプリも出ているようです。

Lemonade

https://lemonade-server.ai/

手順など情報はインターネット上に出ているのでご興味がある方は調査をされてみて下さい。

コメントを残す